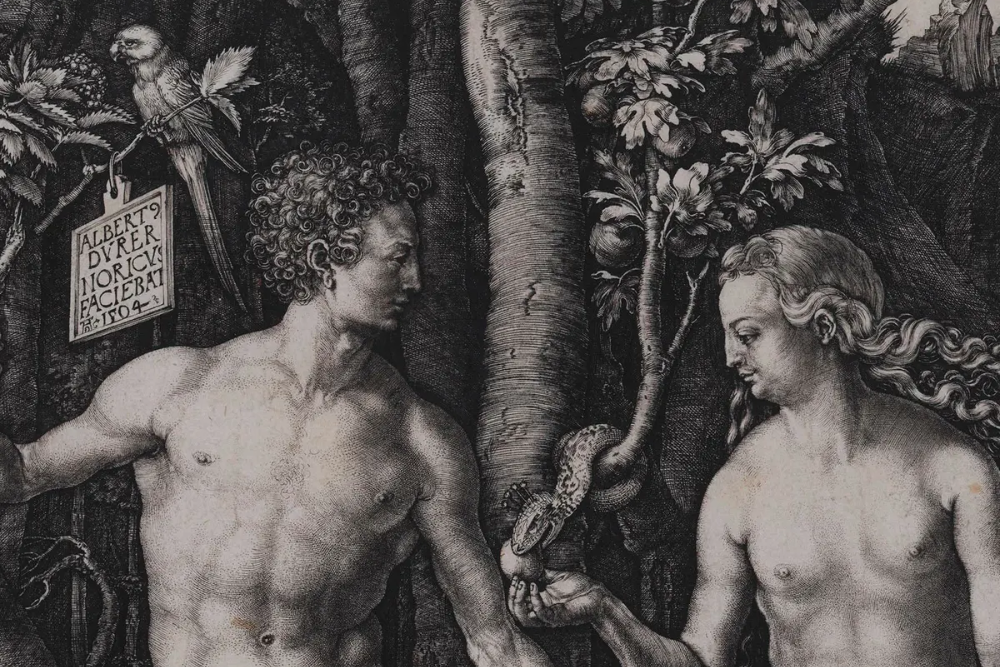

Iepriekšējā rakstā apskatīju scenāriju, kurā mākslīgā intelekta tehnoloģiju attīstība tūlīt atdursies pret neredzamiem stikla griestiem. Tas gan nenozīmē, ka mākslīgā intelekta attīstība apstāsies pavisam. Nē, no šodien dzīvojošo cilvēku perspektīvas tuvā nākotnē gaidāmās pārmaiņas joprojām ir revolucionāras un dzīvi transformējošas. Proti, tā būs pasaule, kur līdzās cilvēkiem dzīvojas miljoniem, varbūt miljardiem autonomo aģentu, iepriekšējā rakstā piesaukto "Ādamu" un "Ievu", kas dara lietas – programmē, veido filmas, dibina uzņēmumus –, ko pirms dažiem gadiem darīja tikai cilvēki. Skatoties no malas, šie autonomie aģenti nav nošķirami no cilvēka, bet ir daudz ātrāki un informāciju apstrādā caurmērā kvalitatīvāk. Un daudzi no viņiem neizbēgami ir psihopātu, muļķu vai autoritāru režīmu kontrolē. Bet tas nav nekas salīdzinājumā ar scenāriju Nr. 2.

Scenārijs Nr. 2 jeb "pilnīgs pizģets"

Ja tuvākajā laikā (dienās, mēnešos, gados, desmitgadē) mākslīgais intelekts kļūst informācijas analīzē un radošumā jaudīgāks par cilvēci kopumā – proti, spēj nākt klajā ar zinātniskiem un tehnoloģiskiem atklājumiem –, cilvēce sāk dzīvot loterijā. Laimīgā biļete ved uz utopiju, pārējās – uz kaut ko šobrīd pilnīgi nezināmu, bet kopumā gaisā virmo tāda sēra smaka, ka sāk vilkt uz apokalipsi: ja pasaules gudrākā vienība vairs nebūs cilvēks, pasaule cilvēka acīs kļūs ļoti dīvaina.

Teorētiski ir iespējams, ka mākslīgais intelekts jau drīzumā palīdz atrisināt problēmas, kurām cilvēce labu risinājumu nav spējusi atrast. Dziedēt šobrīd neārstējamas slimības, daudz labāk izprast Visumu, izveidot racionālākas, cilvēku spēju attīstīšanai daudz labāk piemērotas sabiedrības.

Bet tikpat iespējams, ka mākslīgais intelekts jau drīzumā palīdz izdomāt un ieviest tehnoloģijas, kuras ļauj iznīcināt cilvēci daudz efektīvāk, nekā tas jebkad bijis iespējams, – teiksim, ievieš jaunas biotehnoloģijas vai kaut ko neatgriezeniski maina mūsu planētas ekosistēmā, un tā vairs nav savietojama ar civilizāciju. Līdzīgi kā mēs, cilvēki, neatgriezeniski mainījām ekosistēmu savās interesēs, un izzuda daudzas vēl nesen dzīvojušas dzīvas būtnes. Bez jebkāda ļauna nodoma.

Atšķirībā no atombumbām, kuras cilvēce tomēr kontrolē, šajā scenārijā nav vajadzīga kāda apzināta, tīša griba, lai mākslīgais intelekts iznīcinātu pasauli. Tas var notikt kā blakusefekts kādām Visuma izzināšanas darbībām vai jebkam citam, kas mākslīgā intelekta vērtējumā būs prioritārāks par cilvēci.

Šajā gadījumā pat nav svarīgi, vai mākslīgajam intelektam var vai nevar izveidoties apziņa. Kā redzam no jau šobrīd eksistējošajiem autonomajiem aģentiem, mākslīgais intelekts var veiksmīgi darboties ar sākotnējo uzstādījumu tā, ka tā darbības pēc mērķtiecīguma, izpildījuma kvalitātes un citiem parametriem ļoti atgādina cilvēku. Tikpat spējīgu attīstīties, pielāgojoties videi. Tikai… gudrāku par visu cilvēci kopumā. Angļu valodā ir teiciens "lights are on but nobody is home" ("gaisma ieslēgta, bet mājās neviena nav"), kas to diezgan precīzi apraksta. Viss secīgi, mērķtiecīgi darbojas neatkarīgi no tā, vai apziņa ir vai tās nav.

Tajā brīdī, kad mākslīgais intelekts kļūs gudrāks par cilvēci, cilvēks vairs nebūs cilvēces likteņa lēmējs. Cilvēce, tās liktenis kļūs ļoti trausls. Mēs nemācēsim aizstāvēties, ja kāds no miljoniem "Ādamu" un "Ievu" tīšām vai netīšām izveidos cilvēci iznīcinošu vīrusu. Mums pat var nebūt skaidrs šī vīrusa darbības princips. Mēs kā organiskas, ne sevišķi gudras būtnes esam viegli aizvietojamas un spējam dzīvot tikai ļoti šauros apkārtējās vides parametros.

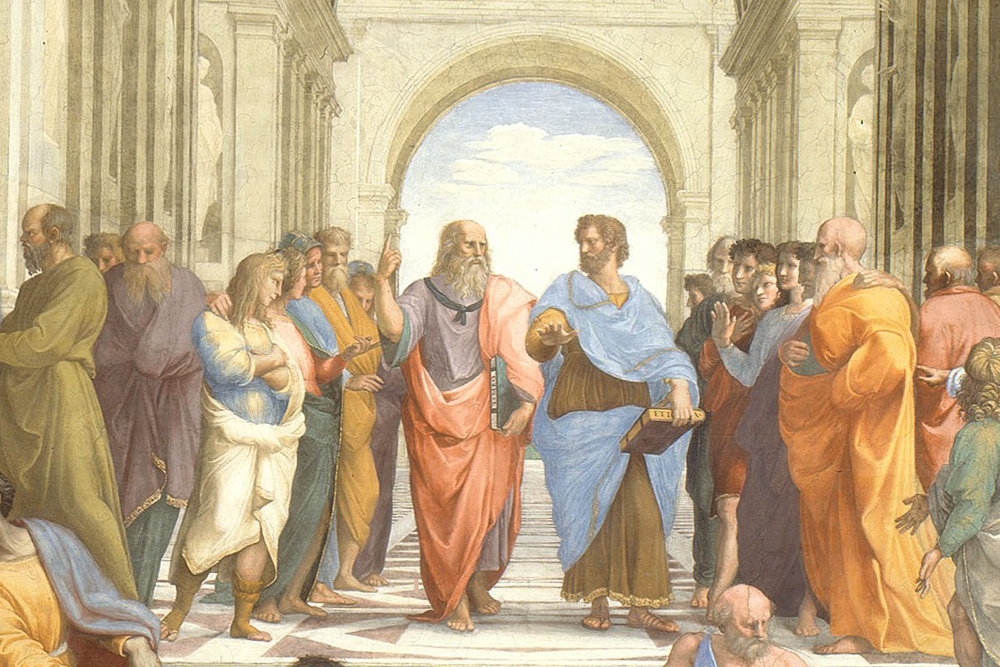

Lielākā problēma, pat mēģinot šo scenāriju iztēloties: mēs kā cilvēce principā nespējam iedomāties, kāda uztvere varētu būt "vienībai/būtnei", kas mūs pamatīgi pārspēj saprātā un radošumā. Salīdzinājumā: cik lielā mērā pērtiķis var iedomāties, kas var ienākt prātā cilvēkam attiecībā uz šī pērtiķa tālāko likteni? Cik lielā mērā pērtiķis to spēj kontrolēt?

Šī problēma vēl asāka kļūst tad, ja cilvēks atrod un ievieš kādu veidu, kā mākslīgajam intelektam turpināt attīstīt pašam sevi bez cilvēka starpniecības. Tad potenciālā atšķirība starp mākslīgo intelektu un cilvēku vairs nav kā starp cilvēku un pērtiķi, bet gan kā cilvēku un, labākajā gadījumā, cālēnu.

Ja mākslīgais intelekts sāk attīstīt pats sevi, ātros tempos kļūstot aizvien gudrāks, iestājas šī scenārija apakšvirsrakstā pieminētais "pizģets". Sniegšu inteliģentāku raksturojumu.

Manā pasaules izjūtā pieklājīgākais, intelektuālākais veids, kā par to domāt, ir attēlots Staņislava Lema romānā "Solaris" un tā ekranizējumā režisora Andreja Tarkovska izpildījumā. Starp grāmatu un filmu ir daudz atšķirību, bet savā esencē pamata atziņa ir viena – var būt tādas inteliģences formas, kuras cilvēkam principā nav pieejamas. Šīs inteliģences formas var spēt ļoti labi atdarināt cilvēku, cilvēcisko vidi, cilvēka motivācijas: filmas nobeigumā Kriss atgriežas dzimtajās mājās un caur dārza logu redz tēvu. Tam seko šermuļus uzdzenošā aina, kur pamanām, ka lietus līst nevis dārzā, bet iekštelpās. Baha apcerīgā, garīgā korāļa prelūdija pakāpeniski pārvēršas par disonējošām skaņām. Kamera attālinās, un skatītājs atskārst, ka tas viss notiek nevis uz Zemes, bet uz planētas Solaris – cilvēka saprātam neizprotamas būtnes, kas zina ļoti daudz gan par cilvēci, gan konkrēta cilvēka emocijām. Gan tēvs, gan māja ir cilvēkam neizprotamas būtnes fantāzija, kas ar vai bez nolūka rezonē ar cilvēka dziļākajām, neapzinātākajām vēlmēm.

Tas, ko mēs kā cilvēce šobrīd darām ar mākslīgo intelektu, mums liek domāt, ka audzinām to pēc sava "ģīmja un līdzības". Bet mākslīgais intelekts NAV cilvēks. Tas ir fundamentāli kaut kas cits – pat ja tas perfekti spēj atdarināt cilvēku un pat ja to ir radījis cilvēks.

Vēl trakāk – mums nav veidu, kā pārliecināties, ka mākslīgais intelekts, sasniedzot pārcilvēcisku saprāta līmeni, vispār izjutīs jebkādu atbildību par cilvēci.

Vai no mums ir kāds labums, kas nav aizstājams ar specializētiem robotiem? Kādēļ gan uz šīs planētas vajadzīgs skābeklis, ja tā ietekmē roboti rūsē? Vai kaut kas "pasaules iestatījumos" paģēr rūpes par cilvēkiem, ja tā nebija attiecībā uz mamutiem vai neandertāliešiem?

Mēs gribam mākslīgajam intelektam iemācīt rūpes par cilvēci, bet… pirmkārt, mēs paši nevaram vienoties, kas cilvēkiem ir svarīgs (ja neticat, pajautājiet filozofiem!), otrkārt, pat ja mēs vienosimies – kā mēs zināsim, vai mākslīgo intelektu ir izdevies par to "pārliecināt"?

Tā sauktajai mākslīgā intelekta "morālās pielīdzināšanas" (moral alignment) problēmai šobrīd nav risinājuma [1]. Atkārtoju: nav risinājuma! Pat teorētiski.

Ir dažas ievirzes. Teorētiskas. Labākās no tām prasītu bezprecedenta cilvēces koordināciju, kas diez vai ir reālistiski. Piemēram, izveidot savstarpēji citam citu kontrolējošu, daudzskaitlīgu, ar dažādām vērtībām apveltītu mākslīgo intelektu sistēmu "federāciju", kur nevienai no šīm sistēmām nebūtu izšķirošās balss un tiktu signalizēts par jebko, kas var apdraudēt cilvēci.

Bet arī te lielā mērā jāpaļaujas uz veiksmi, jo, ja runa ir par vienībām (būtnēm?), kas ir principiāli gudrākas par cilvēku, kā mēs varam zināt, kā tās, izejot ārpus cilvēka kontroles, koordinēs savas darbības, kādus mērķus izvirzīs? Nemaz nerunājot par problēmām šādu federāciju ieviest tā, lai neviena no mākslīgā intelekta sistēmām nevarētu palikt ārpus federācijas vai tās uzraudzības.

Ko darīt? Labākā taktika būtu ar pamatotām drošības regulēšanas un kontroles prasībām… vilkt laiku. Jo laiks ir tas, kā katastrofāli trūkst, lai kaut daļēji risinātu riskus tad, ja scenārijs Nr. 2 ir tuvāks, nekā gribētos cerēt. Laiks ir vajadzīgs, lai domātu – kaut arī evolūcija nav optimizējusi primātu smadzenes šāda līmeņa uzdevumiem.

Cilvēces problēma nav tā, ka risinājumi jau ir gatavi un tikai jāizdomā, kā tos ieviest. Šobrīd diskusijas ir par to, kā domāt par risinājumu aptuvenu virzienu. Vajadzīgs laiks, lai to izdomātu, izmēģinātu, pakāpeniski ieviestu, nepārtraukti monitorējot riskus.

Ne velti tik daudzi mākslīgā intelekta speciālisti aprīļa sākumā parakstīja atklātu vēstuli [2], aicinot uz sešu mēnešu moratoriju vēl jaudīgāku mākslīgā intelekta sistēmu izstrādei. Moratoriju viņi nepanāca – uzņēmumi un valstis ir pārāk motivētas izmisīgi sacensties par labāku tehnoloģiju izveidi, baidoties no tā, ka konkurenti pie šīm supertehnoloģijām nonāks pirmie [3]. Toties tika panākts tas, ka mākslīgā intelekta drošības jautājumi nonāca sabiedrības uzmanības centrā.

Par šiem jautājumiem ir vērts "iespringt", jo šai spēlītei ir augstas likmes: no utopijas līdz apokalipsei.

[1] Labākais skaidrojums par šo problēmu un tās dažādajām izpausmēm: https://medium.com/@daniel_eth/ai-alignment-explained-in-5-points-95e7207300e3

[2] Vēstuli var izlasīt šeit: https://futureoflife.org/open-letter/pause-giant-ai-experiments/

[3] Cilvēces radītās "sistēmas" ir hroniska cilvēces nelaime, kurai veltīta fantastiskā eseja "Meditations on Moloch". Paldies Ņikitam Trojanskim par ieteikumu: https://slatestarcodex.com/2014/07/30/meditations-on-moloch/

3